مدلسازی مولد دادههای ویدیویی در سالهای اخیر پیشرفتهای سریعی داشته است که با پیشرفت در تکنیکهای یادگیری عمیق امکانپذیر شده است. با این حال، کارهای قبلی در این زمینه با محدودیت هایی در مقیاس، وفاداری و انعطاف پذیری نمونه های ویدئویی تولید شده مواجه بوده است. مدلها اغلب بر دستههای باریکی از دادهها، طول ویدیوهای کوتاهتر یا وضوحها و نسبتهای تصویر ثابت تمرکز کردهاند.

Sora نشان دهنده یک پیشرفت بزرگ در جهت غلبه بر این چالش ها و مدل سازی داده های ویدئویی در مقیاس اینترنت در تنوع کامل آن است. Sora که توسط محققان OpenAI توسعه داده شده است، قادر است تا یک دقیقه ویدیوی با کیفیت بالا را مشروط به ورودی های متنی، تصویری یا ویدیویی تولید کند.

Sora با رویکرد فنی منحصر به فرد خود، مرزهای تولید ویدیو را جابجا می کند. از مدلهای diffusion transformer استفاده میکند که بر روی تکههای فضا-زمان استخراج شده از نمایشهای فشرده آموزش دیدهاند. این مسئله به مدل اجازه می دهد تا از ویدیوهایی با مدت زمان، وضوح و نسبت ابعاد متغیر در طیف گسترده ای از دامنه ها یاد بگیرد.

آزمایشهای اولیه نشان میدهد که Sora قابلیتهای نوظهور قابلتوجهی برای استدلال فیزیکی و اجتماعی از خود نشان میدهد. این شامل درک صحنه سه بعدی، ماندگاری شی، تعامل با جهان های مجازی و حفظ انسجام در مدت زمان طولانی است. در حالی که محدودیتهایی باقی مانده است، تواناییهای Sora نشاندهنده پیشرفتی در مدلسازی مقیاس بزرگ ویدئو و پیشرفت به سمت جهانهای شبیهسازی شده است.

محققان تاکید میکنند که قابلیتهای Sora تنها از مقیاسبندی اندازه مدل و دادههای آموزشی، بدون هیچ گونه دانش رمزگذاریشده درباره اشیا یا فیزیک پدیدار میشوند. این موضوع پارادایمی را تقویت می کند که امکان شبیه سازی محیط های پیچیده پر از اشیا، حیوانات و افراد را فراهم می کند.

مدل Sora و آموزش آن

محققان Sora را با استفاده از مدلهای diffusion transformer آموزش داده شده بر روی “وصلههای” ویدئویی و تصویری به عنوان token توسعه دادند. این بر اساس خواص مقیاسپذیری قوی است که قبلاً توسط transformerها در حوزههای دیگر مانند زبان طبیعی و تولید تصویر نشان داده شده بود.

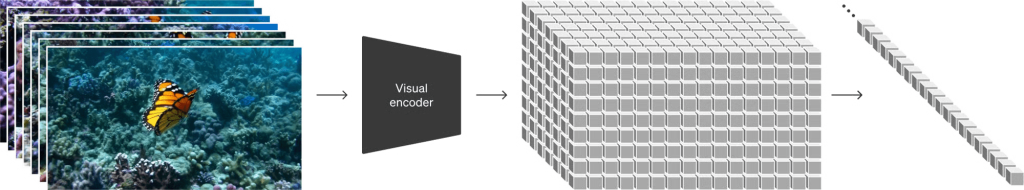

فرآیند آموزش Sora با فشرده سازی ویدیوهای خام در یک نمایش نهفته با ابعاد پایین تر شروع می شود. این فشرده سازی ویدئوها را به صورت زمانی و فضایی (Spatial) متراکم می کند در حالی که اطلاعات بصری اصلی را حفظ می کند.

سپس نهفته های فشرده به دنباله هایی از تکه های فضا-زمان تقسیم می شوند که به عنوان token هایی برای معماری Sora استفاده می شود. این رویکرد امکان آموزش کارآمد را در بین ویدیوها و تصاویر با مدت زمان، وضوح و نسبت ابعاد متفاوت میدهد.

داده های آموزشی برای Sora شامل مجموعه داده های ویدئویی در مقیاس اینترنت است که طیف متنوعی از دامنه های دنیای واقعی را در بر می گیرد. محققان از تکنیک های اقتباس شده از DALL-E برای بهبود وفاداری مدل به ورودی های متنی استفاده می کنند. این شامل ایجاد زیرنویسهای توصیفی برای همه فیلمهای آموزشی با استفاده از یک مدل زیرنویس جداگانه است.

در طول آموزش، Promptهای متنی قبل از ارائه به Sora با استفاده از یک مدل GPT گسترش مییابند. در زمان تولید، Sora قادر به تولید ویدئوهایی با کیفیت بالا تا یک دقیقه و تطبیق با درخواستهای متنی یا مشروط به تصاویر و ویدیوهای ورودی است.

ترکیبی از تکنیکهای مختلف Sora را قادر میسازد تا به سطوح جدیدی از وفاداری و انعطافپذیری برای تولید ویدئو برسد. این زمینه را برای قابلیتهای نوظهور Sora در استدلال فیزیکی و اجتماعی که در طول نمونهگیری به نمایش گذاشته شد، آماده میکند.

قابلیتهای Sora

منبع: OpenAI

در حالی که Sora بدون هیچ گونه مدل سازی صریح فیزیک یا اشیا آموزش دیده بود، محققان متوجه قابلیت های قابل توجهی در استدلال فیزیکی و اجتماعی شدند. Sora قابلیتهای زیر را نشان می دهد:

- سازگاری سه بعدی – Sora می تواند صحنه ها را با حرکت پایدار اجسام به عنوان زوایای دوربین مجازی تغییر و چرخش در فضای سه بعدی ارائه دهد.

- ماندگاری شی – Sora اغلب قادر است حضور اشیا و کاراکترها را حتی در مواقع مسدود یا خارج از کادر ردیابی کند و ثبات آنها را حفظ کند.

- تعامل – Sora میتواند اقداماتی را شبیهسازی کند که جنبههایی از جهانهای تولید شدهاش را به روشهای ساده تغییر میدهند، مانند یک بوم نقاشی شده یا غذای خورده شده.

- دنیای دیجیتال – Sora توانایی شبیهسازی محیطهای مصنوعی مانند بازیهای ویدیویی، کنترل بازی در حین رندر کردن جهان را نشان میدهد.

- انسجام دوربرد – علیرغم برخی شکستها، اغلب در طول نمونهبرداری انسجام اشیاء، صحنهها و .افراد را در مدت زمان طولانی حفظ میکند.

- دستکاری توسط متن – با استفاده از تکنیک های اقتباس شده از Sora ،DALL-E می تواند سبک، محتویات و مدت ویدیوهای تولید شده را از طریق پیام های متنی دستکاری کند.

ظهور این قابلیتهای استدلال فیزیکی و اجتماعی از مقیاسبندی ساده اندازه و دادههای مدل نشان میدهد که پیشرفت مداوم در این جهت ممکن است به شبیهسازی جهانی قوی منجر شود. محققان استدلال میکنند که مقیاس مدل به خودی خود امکان شبیهسازی پیچیدگی دنیای ما را بدون نیاز به دانش از پیش برنامه ریزی شده فراهم میکند.

با این حال، Sora هنوز محدودیتهای قابل توجهی در مدلسازی دقیق تعاملات پیچیدهتر اشیاء و حفظ انسجام کلی در نمونههای طولانی دارد.

جمعبندی

مدل جدید Sora نشاندهنده یک پیشرفت بزرگ در مدلسازی مولد در مقیاس بزرگ دادههای ویدئویی متنوع است. با استفاده از diffusion transformerهای آموزشدیده بر روی وصلههای ویدئویی در مقیاس اینترنت، Sora میتواند تا یک دقیقه ویدیوی با کیفیت بالا و مشروط به ورودیهای متن، تصویر یا ویدئو تولید کند. بدون هیچ دانش فیزیک از پیش برنامهریزی شده ای، Sora قابلیت های نوظهور قابل توجهی مانند ثبات سه بعدی، ماندگاری شی، تعامل با جهان های مجازی و انسجام دوربرد را از خود نشان می دهد. با این حال، محدودیتها در مدلسازی دقیق فیزیک پیچیده و حفظ انسجام کلی در مدت زمان بسیار طولانی باقی میمانند. در حالی که تحقیقات آینده برای رسیدگی به این محدودیتها مورد نیاز است، مهارتهای نشاندادهشده Sora نوید بزرگسازی مدلهای تولید ویدیو را برای شبیهسازی جهانهای واقعیتر نشان میدهد. محققان استدلال می کنند که مقیاس مدل خود ممکن است پیچیدگی جهان ما را شبیه سازی کند.

on یک دقیقه در جهان Sora